Un team del Robotics Institute della Carnegie Mellon University ha sviluppato un framework robotico che modella computazionalmente il processo creativo della pittura, agendo - come un pittore - con vernice e pennello.

Trattare di robotica applicata al processo creativo – e, più in particolare, al processo pittorico – rimanda immediatamente a quello che è l’obiettivo più ambizioso dell’ambito di studi che fa capo all’intelligenza artificiale, ossia creare una macchina in grado di pensare e di agire come l’essere umano, anche per quanto attiene alla sfera della creatività e dell’espressione artistica.

Relativamente a queste ultime, ricordiamo la Generative AI – o intelligenza artificiale generativa – abilitata da tecnologie capaci di produrre dati sintetici a supporto delle capacità e delle attività creative dell’essere umano.

Ne sono un esempio DALL-E, algoritmo AI sviluppato da OpenAI nel 2021, e la sua versione più recente DALLE-E 2 (gennaio 2022), entrambi addestrati – attraverso milioni di immagini (comprese quelle di dipinti) presenti in rete e delle relative didascalie – a produrre contenuti visivi (output) sulla base di richieste espresse in forma scritta (input) ed elaborate da un sistema di Natural Language Processing.

Ma, oltre a DALL-E, esiste anche la “pittura robotica”, con numerosi esempi di dipinti fisici (non digitali) creati da robot che – negli anni scorsi – hanno addirittura partecipato a concorsi.

Attualmente, gli approcci esistenti alla pittura robotica possono essere classificati in due gruppi, come osservano i ricercatori del Robotics Institute, in seno alla Carnegie Mellon University (Pennsylvania), autori dello studio “FRIDA: A Collaborative Robot Painter with a Differentiable, Real2Sim2Real Planning Environment”:

«Vi sono i sistemi di verniciatura robotizzati ingegnerizzati, in grado di riprodurre fedelmente le immagini in ingresso, e i sistemi di verniciatura robotici abilitati all’apprendimento, che generalmente utilizzano ambienti di simulazione per pianificare le pennellate e, quindi, eseguirle utilizzando un robot fisico»

In quest’ultimo caso – precisano i ricercatori – «a causa dell’enorme divario tra immagini in ingresso e pennellate basate su metodi di simulazione, i dipinti prodotti risultano di scarsa qualità e, talora, sono addirittura irrealizzabili».

La pittura possiede una natura dinamica. Non la si può inquadrare come “robotica”: questo è il cambio di paradigma che ha portato il team di studio della Carnegie Mellon University a mettere a punto una metodologia in cui viene, sì, generato un piano iniziale per avviare l’esecuzione del dipinto da parte del robot, ma questo viene continuamente aggiornato man mano che il dispositivo robotico acquisisce maggiore informazioni dall’ambiente. Vediamo a che cosa ha portato tale nuovo approccio.

Robotica e processo creativo: un framework che agisce con vernice e pennello

Come modellare computazionalmente processi creativi quale la pittura, per supportare la creatività umana? L’interrogativo che ha guidato i ricercatori nel loro lavoro in tema di robotica e processo creativo, è stato questo. E il punto di arrivo è stato il Framework and Robotics Initiative for Developing Arts (FRIDA), sistema robotico integrato che, utilizzando tecniche di intelligenza artificiale come quelle che alimentano ChatGPT, il chatbot immesso sul mercato il 30 novembre 2022 da OpenA, e DALL-E – che generano rispettivamente testi e immagini in risposta a determinate richieste – trae ispirazione da un testo o da un’immagine in input per produrre un dipinto fisico, non digitale.

«La peculiarità del sistema sviluppato è consentire l’adeguamento degli obiettivi in base alla progressiva esecuzione del dipinto. Contrariamente ai sistemi di verniciatura robotizzati esistenti, in cui una sequenza di azioni completamente programmata viene eseguita alla cieca da un robot, l’approccio alla pittura di FRIDA alterna la generazione di contenuti e la pianificazione delle azioni, al fine di ottenere un’ottimizzazione continua del lavoro» spiegano gli autori.

Le tecnologie impiegate – specificano – si basano su due intuizioni del processo artistico e cioè che «l’arte ha obiettivi semantici di alto livello e che è un processo dinamico che deve adattarsi e riconsiderare costantemente i propri obiettivi durante il processo di creazione».

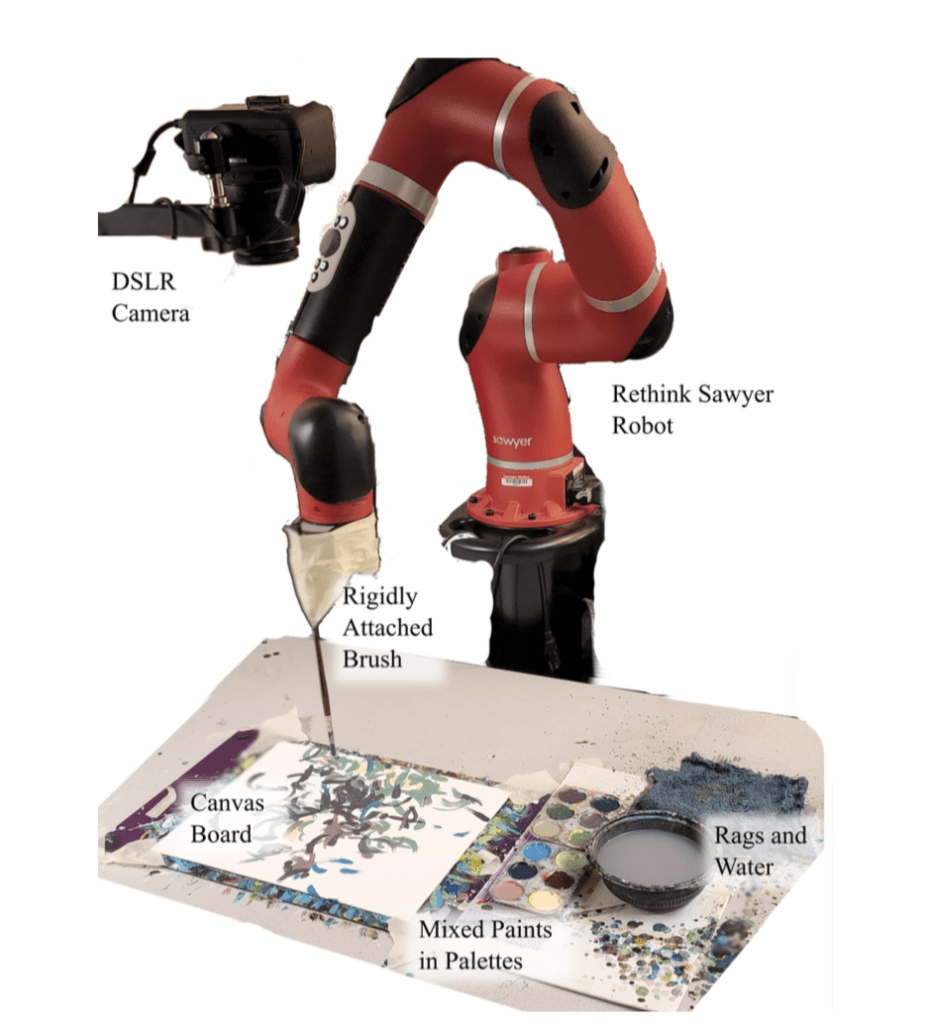

Il sistema robotico utilizzato è Sawyer, robot collaborativo (Rethink Robotics) di elevata precisione, munito di telecamera per consentire alla macchina di «percepire la tela».

Il team di ricercatori, durante il lavoro, ha utilizzato un cartone di tela come superficie pittorica. Le vernici acriliche premiscelate sono state fornite al robot in vassoi tavolozza, con un massimo di dodici opzioni di colore disponibili.

«Per eliminare la vernice dal pennello, al robot viene fornito uno straccio imbevuto d’acqua. La spazzola è fissata rigidamente all’effettore finale del robot ed è sempre tenuta perpendicolare alla tela. Le posizioni di tutti i materiali rispetto al robot – dalla tela alla vernice, fino allo straccio d’acqua – sono esplicitamente programmate» rimarca.

La rete neurale artificiale e la tecnica Real2Sim2Real impiegate

In tema di robotica e processo creativo, un approccio rudimentale alla creazione di un ambiente di pittura robotizzata – fa notare il team – è quello di consentire al robot di dipingere in maniera casuale e continua, in modo da raccogliere un set di dati sufficientemente ampio di azioni da fargli compiere.

«Tuttavia, benché questo metodo funzioni bene in ambienti simulati, dove migliaia di pennellate possono essere prodotte nell’ordine di secondi, la generazione di un set di dati reale di queste dimensioni non è pratico. La pittura nella vita reale è lenta e se il pennello o altri materiali venissero alterati, l’intero processo dovrebbe essere riavviato».

Cuore del sistema robotico messo a punto è, dunque, una rete neurale artificiale a strati lineari seguiti da due strati convoluzionali, addestrata per mezzo di un set di dati video contenente diversi tratti del pennello (non casuali) realizzati su una tela esistente.

In particolare, gli autori, per allenare l’algoritmo a comprendere gli input visivi e linguistici, hanno attinto a un ampio dataset (che coniuga immagini e testo) come Contrastive Language-Image Pre-Training (CLIP) di OpenAI.

A differenza, però, di DALLE-E e DALLE-E 2, FRIDA produce dipinti fisici su canvas. E, per ridurre il divario tra simulazione e realtà di quanto prodotto, tra ciò che il sistema robotico compone nella simulazione e ciò che dipinge sulla tela, il team di ricerca ha impiegato Real2Sim2Real, ovvero una tecnica di apprendimento auto-supervisionato che viene applicata ad alcune tipologie di robot, in grado di realizzare simulazioni fisiche realistiche, rappresentative della realtà.

«Si tratta di una tecnica che non apprende utilizzando dati puramente simulati, né dati puramente reali, ma avvalendosi di un metodo che li bilancia, rendendo così la simulazione il più accurata possibile» commentano gli autori.

Ma, in tema di robotica e processo creativo, come funziona nel concreto la macchina? L’utente illustra il dipinto che desidera ottenere (verbalmente oppure per immagini), il robot, grazie all’algoritmo di machine learning, crea una simulazione e, successivamente, pianifica la realizzazione del dipinto su tela, aderendo agli obiettivi esplicitati dall’utente.

La telecamera posta in alto serve al sistema per riprendere le immagini del dipinto durante i lavori di esecuzione, supportandolo nella valutazione dei suoi progressi e, laddove necessario, nel perfezionare il piano di pittura.

Robotica e processo creativo: impatti e ricerca futura

Nelle intenzioni degli autori, il loro lavoro in tema di robotica applicata al processo creativo non intende sostituirsi agli artisti. Anzi – sottolineano – il suo obiettivo è esattamente il contrario, vale a dire collaborare con i pittori, promuovendone la creatività e l’estro per mezzo di modalità intuitive che utilizzano il linguaggio naturale e immagini campione. Inoltre, il sistema sviluppato è open source, proprio per sostenere la ricerca interdisciplinare e l’educazione nella robotica e nelle arti.

«Mentre, nella ricerca finora portata avanti, la generazione di contenuti visivi simulati e la pittura fisica da parte del robot sono state tenute separate, l’ambiente di pianificazione che abbiamo ricreato col nostro framework robotico consente l’intreccio continuo di vari modelli di generazione di contenuti basati su reti neurali profonde e l’effettiva pianificazione della pittura» ribadisce il gruppo di ricerca.

Nel lavoro futuro, l’obiettivo è esplorare altre modalità di lavoro di FRIDA, che finora ha sperimentato solo la pittura con opzioni di colore già date, le pennellate indipendenti, nessuna modellazione dell’umidità della vernice, nessuna modellazione della quantità di vernice presente sul pennello e il pennello fissato perpendicolarmente alla tela. Sono limitazioni che andranno superate, fanno sapere i ricercatori.

Infine, se il processo pittorico è adattabile e dinamico, tanto da fare emergere nuovi stili, il sistema robotico descritto adatta, invece, i suoi obiettivi nel momento stesso in cui dipinge, vincolando così la definizione stessa di “dinamica”. Il futuro step – conclude i team – andrà nella direzione di una maggiore esplorazione dell’atto creativo, cerando di “creare” scavalcando i rigidi schemi della pianificazione e dell’adattamento agli obiettivi finali del dipinto.

![Particolare di una catena di unità robotiche messe a punto dai ricercatori dell’Università di Amsterdam, ciascuna composta da un rotore posto sopra un motore elettrico [Credit: “An endless domino effect” - Università di Amsterdam - https://www.uva.nl/en/shared-content/subsites/institute-of-physics/en/news/2024/03/an-endless-domino-effect.html].](https://tech4future.info/wp-content/uploads/2024/04/solitoni-topologici-metamateriali-robotici-2024-343x198.webp)

![Fotografia che ritrae, da sinistra, la parte esterna e la parte interna dei guanti per interazioni tattili, con sensori tattili e attuatori vibrotattili (evidenziati dai riquadri) integrati [Credit: “Adaptive tactile interaction transfer via digitally embroidered smart gloves” - Department of Electrical Engineering and Computer Science, Massachusetts Institute of Technology - https://www.nature.com/articles/s41467-024-45059-8].](https://tech4future.info/wp-content/uploads/2024/03/guanti-per-interazioni-tattili-finalizzate-apprendimento-343x248.png)